News center

ECCV 2022 | 光鉴科技稀疏深度补全研究成果入选计算机视觉顶会

10月23日,欧洲计算机视觉国际会议ECCV 2022于以色列特拉维夫盛大开幕。其中,光鉴科技联合清华大学电子系的研究工作《GraphCSPN:Geometry-Aware Depth Completion via Dynamic GCNs》被ECCV收录。

ECCV是全球顶尖的计算机视觉会议之一,每两年举办一次,和 ICCV、CVPR并称为计算机视觉方向的三大顶级会议。本届ECCV总计收到投稿8170篇,是ECCV 2020的投稿量的近两倍,创下历史新高,其中录用率不到20%。

伴随移动机器人和自动驾驶的蓬勃发展,视觉算法对于输入数据的要求越来越高,需要完整、稠密且高质量的深度图像来提供所需的视觉信息。本次光鉴科技入选的论文通过创新的图卷积空间传播网络,对深度图像进行信息补全,获得高质量的稠密深度图像,可以更好地为机器人、自动驾驶等领域提供技术支持。

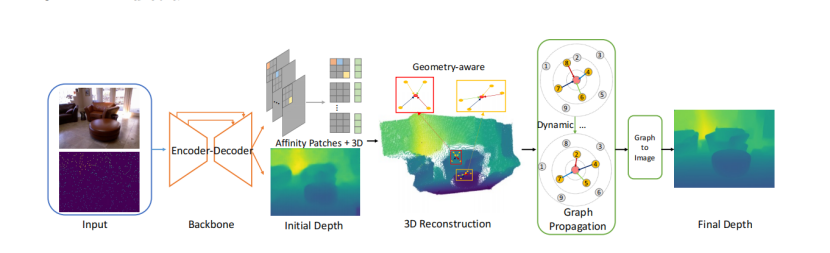

为解决上述痛点,本论文提出了GraphCSPN (Graph Convolution based Spatial Propagation Network),一种基于图卷积的空间传播网络,来完成稀疏深度图的补全。

论文中提及的 GraphCSPN 模型,主要有以下几点优势:

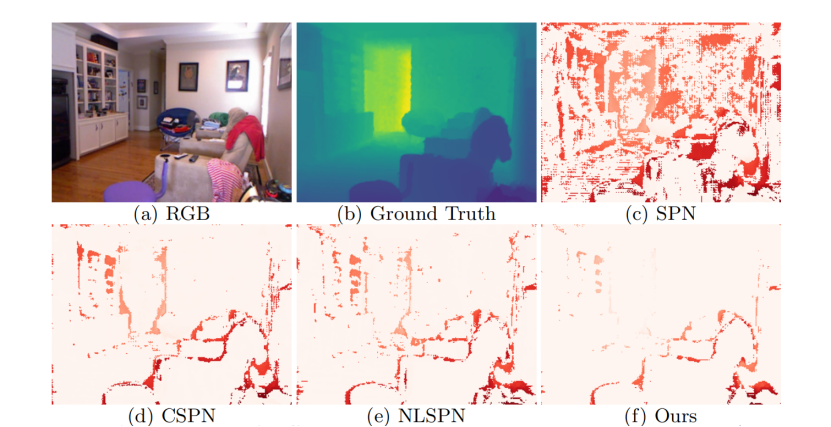

1. 利用对边界的注意力机制来动态更新图网络结构,从而拥有更优秀的几何感知能力,捕获局部信息和全局深度的关系,更好地进行深度补全。在下图中,红色内容表示处理后的深度图与理想深度图之间的误差,可以明显看到,与传统方法(图c-e)相比,GraphCSPN(图f)在物体边界位置具有更小的深度误差。

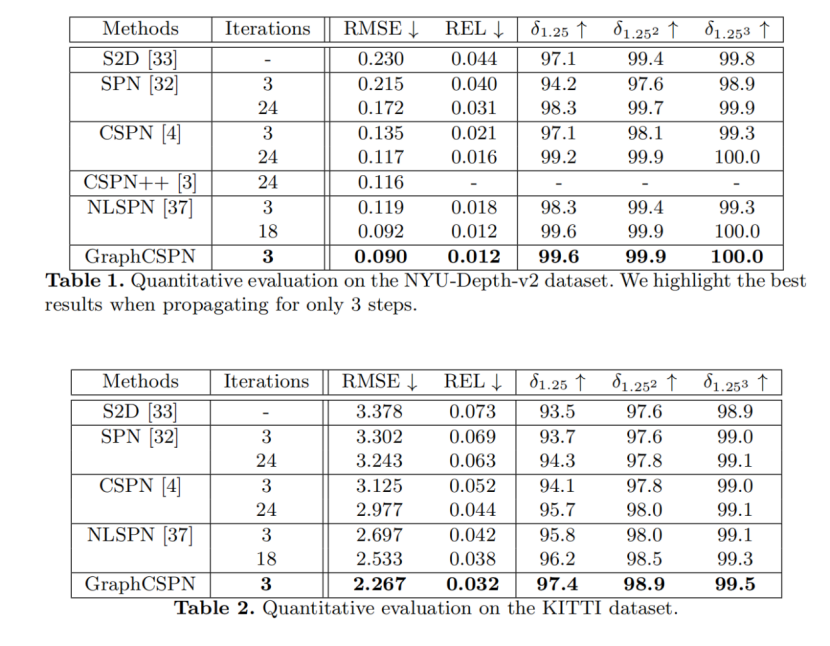

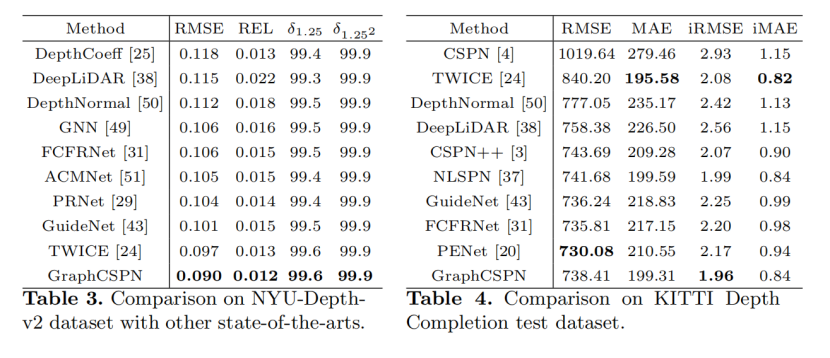

2.传统的传播模型需要迭代18次以上才能获取较好的深度质量,而 GraphCSPN 只需要3次或者更少传播迭代次数,就可以快速收敛。并且,所获取的深度图像在精度上可以达到业界最佳水平。

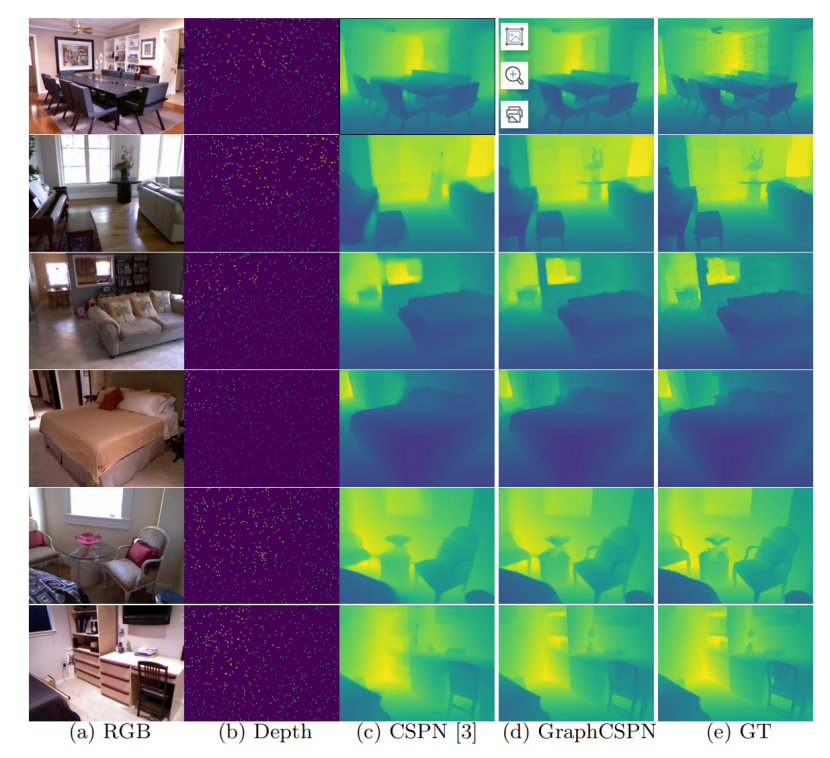

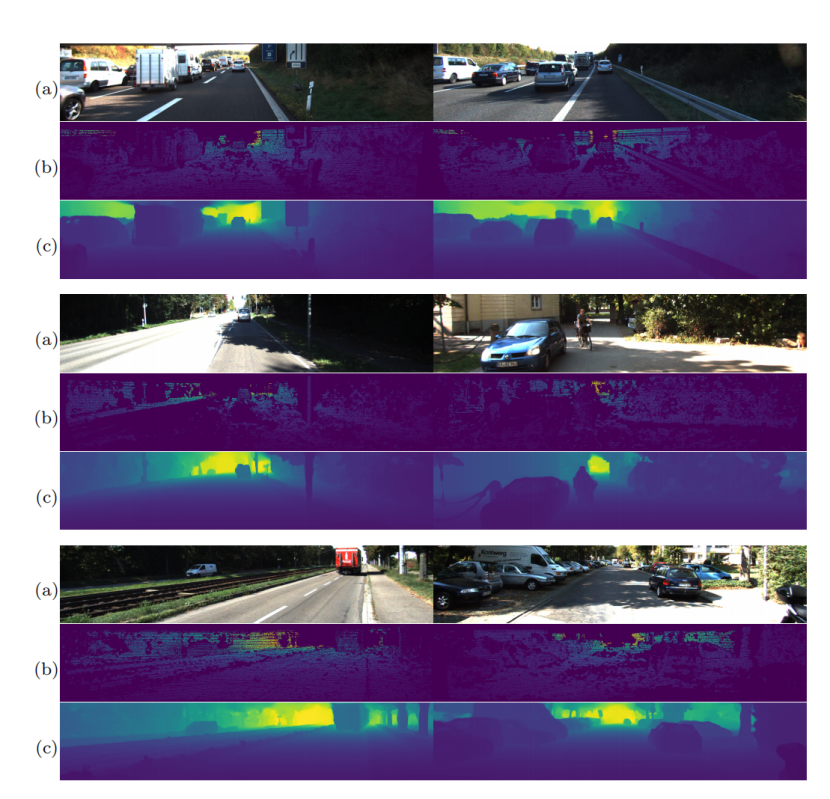

3.在室内NYU-Depth-v2和室外KITTI数据集的测试中,GraphCSPN 均可以得到最佳成绩。

人工智能技术的普及与发展进一步促进计算机视觉的深入研究。光鉴科技将进一步增加研发投入,助力智能机器人、自动驾驶等领域获取到更高质量的3D信息,将更多创新、成熟的技术及解决方案应用在全球的各个行业中,成为闪亮的“中国智造”名片。